在统计概率体系中,数据整理是所有分析工作的起点。无论是概率计算、统计分析,还是后续的数据建模与决策分析,都建立在规范化的数据整理基础之上。通过系统的数据整理流程,原始数据被转化为结构清晰、可解释、可计算的信息,为概率推断与模型构建提供可靠依据。

一、数据整理在统计概率体系中的基础地位

数据整理为何是统计分析的核心环节

在任何统计概率分析场景中,数据整理都承担着承上启下的作用。原始数据通常存在冗余、缺失、异常或格式混乱的问题,如果缺乏有效的数据整理,后续概率计算与统计分析将难以保证准确性。

数据整理的核心目标包括:

-

提高数据质量

-

建立结构化数据基础

-

支持概率模型构建

-

降低统计误差风险

在实际数据分析流程中,数据整理往往占据整体工作时间的50%以上,这一比例体现了数据整理在统计概率中的重要性。

二、数据整理的标准流程与关键步骤

1. 数据清理:确保统计分析的可靠性

数据整理的步是数据清理。该阶段聚焦于数据质量控制。

主要工作包括:

-

识别缺失值并进行合理填补或删除

-

检测异常值并进行逻辑校验

-

修正错误记录与重复数据

通过系统化的数据整理操作,可以显著降低统计偏差,为概率推断提供真实可靠的数据基础。

2. 数据分组与频率分布构建

在完成基础清理后,数据整理进入结构化阶段。数据分组是数据整理的重要方法。

具体操作包括:

通过数据整理形成频率分布表,可以直观展示数据的集中趋势与离散程度。

数据整理与频率分布示例

| 分组区间 |

频数 |

相对频率 |

| 0-10 |

12 |

0.12 |

| 10-20 |

30 |

0.30 |

| 20-30 |

38 |

0.38 |

| 30-40 |

20 |

0.20 |

这种数据整理结构为经验概率分布构建提供直接依据。

3. 排序与汇总:形成描述性统计基础

排序与汇总是数据整理中的关键步骤。通过对数据进行升序或降序排列,可以快速识别:

同时,在数据整理过程中计算以下描述性统计量:

这些指标构成统计分析与概率模型参数估计的基础。

三、数据整理与概率分布构建

从频率分布到经验概率分布

在统计概率框架下,数据整理不仅仅是结构优化,更是概率建模的前置条件。

基于数据整理后的频率分布,可以推导出:

经验分布为后续理论分布拟合提供参考。

理论分布拟合与概率建模

完成数据整理后,可进一步进行概率分布拟合,例如:

通过数据整理得到的统计特征值(均值、方差),为理论模型参数估计提供依据。这一过程属于典型的概率建模与统计推断流程。

四、数据整理在统计分析中的延伸价值

支撑假设检验与决策分析

高质量的数据整理是开展假设检验的前提。若数据整理不规范,显著性检验结果可能出现偏差。

在统计概率分析中,数据整理直接影响:

因此,数据整理不仅是技术步骤,更是决策分析质量控制环节。

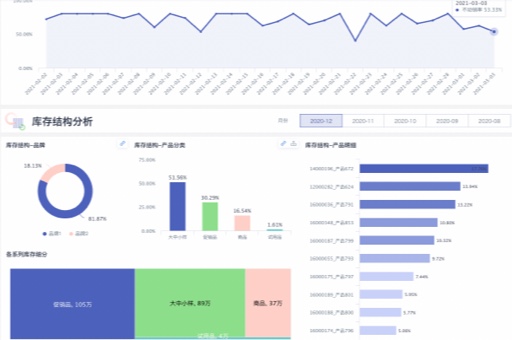

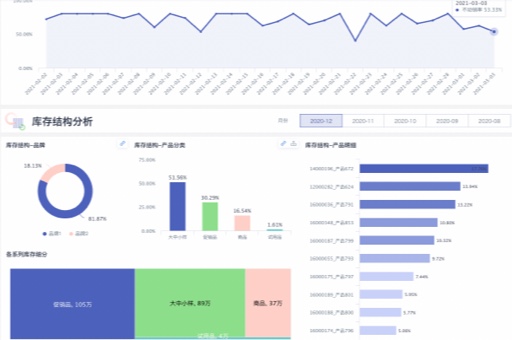

数据整理与数据可视化结合

在现代数据分析场景中,数据整理常与数据可视化结合使用。

常见形式包括:

数据整理后的结构化数据,使可视化表达更具逻辑性,从而增强统计解释能力。

五、数据整理的核心价值总结

数据整理对统计概率体系的综合影响

从统计方法论角度看,数据整理承担以下功能:

-

将原始数据转化为结构化数据

-

揭示数据分布规律

-

支持概率计算与模型推断

-

提升统计分析效率

数据整理贯穿于数据清洗、数据分组、频率分布构建与概率分布拟合的全过程。

六、数据整理关键步骤对比表

| 数据整理阶段 |

核心任务 |

对统计概率的影响 |

| 数据清理 |

修正错误、处理缺失 |

提高数据可靠性 |

| 数据分组 |

构建区间与类别 |

支持频率分布分析 |

| 排序汇总 |

计算统计量 |

支撑参数估计 |

| 概率构建 |

拟合理论分布 |

支持概率推断 |

七、数据整理方法体系的应用场景

在企业数据分析与科研统计中,数据整理具有广泛应用:

-

市场调研数据整理

-

金融风险数据整理

-

质量控制数据整理

-

医学统计数据整理

无论应用领域如何变化,数据整理始终是统计概率分析不可替代的基础环节。

结语:构建系统化数据整理能力

在统计概率框架下,数据整理不仅是技术步骤,更是分析逻辑的起点。通过系统化的数据整理流程,可以将杂乱的数据转化为有序的信息结构,为统计分析、概率计算与决策支持提供坚实保障。

从数据清理到频率分布构建,从排序汇总到概率模型拟合,数据整理贯穿统计全过程。建立规范的数据整理机制,是提升统计分析准确性与可信度的关键路径。

版权声明:本文内容由网络用户投稿,版权归原作者所有,本站不拥有其著作权,亦不承担相应法律责任。如果您发现本站中有涉嫌抄袭或描述失实的内容,请联系我们jiasou666@gmail.com 处理,核实后本网站将在24小时内删除侵权内容。